Zabezpieczenie przyszłości e-commerce: wdrożenie llms.txt w celu zapewnienia widoczności w wyszukiwarkach AI w 2026 roku

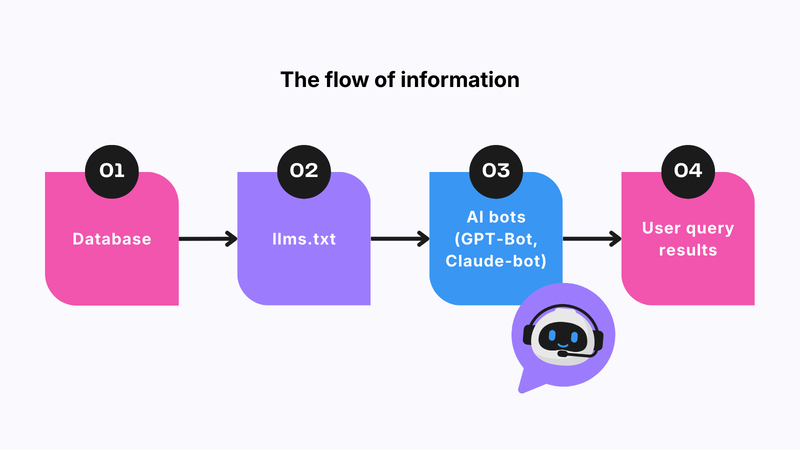

Netkodo wdrożyło dedykowany plik llms.txt dla Scout & Nimble jako element przejścia od klasycznego SEO do optymalizacji pod odpowiedzi modeli (GEO).

Poprzez dostarczenie uporządkowanej mapy kategorii w formacie Markdown oraz rozbudowanej sekcji FAQ zapewniliśmy, że modele AI otrzymują rzetelne dane o marce, bez zauważalnego wpływu na wydajność serwera.

Scout & Nimble działa w segmencie premium rynku projektowania wnętrz, w którym utrzymanie pozycji lidera w 2026 roku wymaga optymalizacji sposobu, w jaki marka jest interpretowana przez sztuczną inteligencję.

Zaproponowaliśmy wdrożenie pliku llms.txt jako proaktywną inicjatywę badawczo-rozwojową, która ma zapewnić klientowi przewagę nad nadchodzącymi trendami rynkowymi.

Definicja llms.txt: ustandaryzowany plik tekstowy podobny do robots.txt, który zawiera skondensowaną wersję treści strony internetowej w formacie Markdown, zaprojektowaną specjalnie tak, aby crawlery dużych modeli językowych (LLM) mogły ją łatwo odczytać i zrozumieć.

Głównym celem jest Generative Engine Optimization GEO, czyli zapewnienie, że modele AI opierają się na zweryfikowanych faktach dotyczących marki, a nie konfabulacjach (halucynacjach) modelu lub domysłach.

Podsumowując: zminimalizowaliśmy ryzyko zgadywania przez AI poprzez dostarczenie faktograficznego przewodnika opisującego kategorie marki oraz zasady sprzedaży.

Opracowaliśmy dedykowane rozwiązanie techniczne, dostosowane do architektury sklepu Scout & Nimble.

| Parametr |

Dedykowane rozwiązanie Netkodo |

Standardowe podejście oparte na wtyczce |

|---|---|---|

| Typ generowania | Statyczne (generowane raz na 24 godziny) | Często dynamiczne (generowane przy każdym żądaniu) |

| Obciążenie serwera | Zerowe podczas crawlowania przez boty | Możliwe skoki obciążenia przy intensywnym scrapowaniu |

| Źródło danych | Produkcyjna baza danych | Często opóźnione przez synchronizację z PIM/ERP |

| Format | Przejrzysta hierarchia Markdown | Często chaotyczny lub nieuporządkowany |

Poniżej przykład decyzji architektonicznej, która ma znaczenie dla jakości danych i stabilności.

Systemy PIM lub ERP często zawierają techniczny szum, który jest nieistotny z perspektywy AI, a dodatkowo mogą generować opóźnienia synchronizacji. Pobierając dane bezpośrednio z bazy produkcyjnej, zapewniamy, że AI porusza się po tej samej, aktualnej strukturze kategorii, którą widzą użytkownicy.

To zmniejsza ryzyko, że model będzie sugerował kategorie wyłączone lub nieaktywne.

Zamiast surowej listy produktów dostarczyliśmy uporządkowany hub tematyczny.

Wskazówka dla deweloperów: skuteczna integracja z AI polega na dostarczeniu przejrzystej mapy oraz jasnych zasad działania, a nie na przekazywaniu wyczerpujących, surowych danych. Skup się na strukturze i FAQ. Dostarcz mapę kategorii oraz reguły gry, a AI zajmie się resztą.

Skuteczność wdrożenia została zweryfikowana poprzez wprowadzenie adresu URL pliku do ChatGPT, Claude oraz Perplexity.

Wdrożenie dla Scout & Nimble pokazuje, że skuteczna integracja AI w e-commerce opiera się na dostarczeniu przejrzystej mapy oraz jasnych zasad, a nie na przekazywaniu wyczerpujących, surowych danych.

Podejście Netkodo stawia na stabilność techniczną i spójną logikę biznesową, dzięki czemu wraz z ewolucją standardów AI dane marki pozostają dostępne i prawidłowo interpretowane przez GPT Bot, Claude bot oraz inne wiodące crawlery.

Plik llms.txt to ustandaryzowany, czytelny dla maszyn plik tekstowy, zazwyczaj w formacie Markdown, umieszczony w katalogu głównym strony internetowej.

Podobnie jak robots.txt dostarcza instrukcji dla crawlerów wyszukiwarek, llms.txt stanowi skondensowaną instrukcję dla Large Language Models.

Pełni rolę nadrzędnego źródła prawdy, oferując przejrzystą mapę hierarchii kategorii, kluczowe zasady biznesowe oraz dane o wysokiej wartości, aby zapewnić, że modele AI interpretują markę w sposób dokładny i zgodny z rzeczywistością.

W kontekście sztucznej inteligencji halucynacja występuje wtedy, gdy model generuje informacje brzmiące pewnie i płynnie, lecz faktycznie nieprawdziwe lub nieoparte na rzeczywistych danych.

Dla marki e-commerce takiej jak Scout & Nimble może to oznaczać, że AI błędnie twierdzi, iż produkt jest dostępny w magazynie, wymyśla zasady zwrotów albo szacuje koszty wysyłki na podstawie ogólnych wzorców zamiast konkretnych reguł sklepu.

Plik llms.txt został zaprojektowany właśnie po to, aby eliminować tego typu halucynacje poprzez osadzanie odpowiedzi AI w zweryfikowanych faktach pochodzących bezpośrednio z bazy danych.

Modele posiadają okno kontekstowe, które ogranicza ilość informacji możliwych do przetworzenia jednocześnie. Jeśli deweloper spróbuje wymienić każdy produkt w pliku llms.txt, model może przekroczyć ten limit i przerwać odczyt, ignorując kluczowe sekcje, takie jak FAQ czy polityki prawne.

Skupiając się na hubach produktowych oraz logicznej strukturze kategorii, plik mieści się w tych ograniczeniach, dzięki czemu najważniejsze zasady biznesowe są zawsze traktowane priorytetowo i prawidłowo interpretowane.

Głównym celem jest Generative Engine Optimization GEO.

Poprzez dostarczenie czytelnej dla maszyn instrukcji działania Netkodo zapewnia, że modele AI opierają się na zweryfikowanych faktach dotyczących marki oraz zasadach sprzedaży, zamiast na założeniach probabilistycznych czy halucynacjach podczas odpowiadania na pytania użytkowników o markę.

Wybrano plik statyczny, generowany co 24 godziny, aby zapewnić optymalną wydajność i bezpieczeństwo.

Takie podejście eliminuje dodatkowe obciążenie serwera produkcyjnego przez boty AI, gwarantując szybkie działanie strony dla użytkowników, a jednocześnie udostępniając botom gotowy do odczytu plik tekstowy.

Podjęliśmy strategiczną decyzję o wykluczeniu tysięcy linków do pojedynczych produktów, ponieważ modele AI mają ograniczone okno kontekstowe.

Nadmierne przeładowanie pliku mogłoby sprawić, że model przerwie jego odczyt w połowie, pomijając kluczowe informacje o wysokiej wartości, takie jak zasady zwrotów czy FAQ marki.

System jest w pełni skalowalny, ponieważ opiera się na logicznym drzewie kategorii, a nie na szczegółowej liście produktów.

Jeśli Scout & Nimble podwoi swój asortyment, AI nadal będzie poruszać się po tej samej, stabilnej mapie kategorii oraz hubach produktowych, co zapobiega nadmiernemu rozbudowaniu pliku llms.txt i jego przeciążeniu z perspektywy przetwarzania przez modele.

Wybór danych koncentrował się na najczęstszych pytaniach, jakie użytkownicy zadają modelom LLM, w tym:

Plik pobiera dane bezpośrednio z produkcyjnej bazy danych sklepu, która stanowi źródło prawdy dla warstwy frontendowej.

Dzięki temu AI widzi dokładnie tę samą hierarchię kategorii oraz treści blogowe co użytkownik, co eliminuje opóźnienia synchronizacji oraz techniczny szum często występujący w systemach PIM lub ERP.

Plik został przetestowany poprzez bezpośrednie przekazanie jego adresu URL do modeli takich jak ChatGPT, Claude oraz Perplexity.

Testy potwierdziły, że modele natychmiast zrezygnowały z improwizowania odpowiedzi i dostosowały je do konkretnych wytycznych zawartych w pliku.

Netkodo wykorzystało zmodyfikowaną wersję swojego autorskiego, stabilnego skryptu używanego wcześniej do obsługi sitemap.xml oraz robots.txt.

Zapewniło to pełną kontrolę nad hierarchią Markdown oraz pozwoliło uniknąć nadmiarowego kodu i zbędnych funkcji, które często występują w zewnętrznych wtyczkach.

Najważniejszą zasadą jest unikanie prób manipulowania AI poprzez przeładowywanie pliku nadmiarem treści.

Należy skupić się na przejrzystej strukturze kategorii oraz rzetelnej sekcji FAQ. Jeśli dostarczysz dobrą mapę i jasne zasady działania, AI jest wystarczająco inteligentna, aby skutecznie poruszać się po pozostałej części sklepu.

Przewidujemy, że w ciągu najbliższego roku plik llms.txt stanie się równie powszechny jak sitemap.xml.

Podczas gdy sitemap służy tradycyjnym wyszukiwarkom, llms.txt stanowi podstawową infrastrukturę dla zakupów wspieranych przez AI oraz wyszukiwania generatywnego.